江波龙亮相2026 AMD渠道&新兴伙伴生态大会,以集成存储共建端侧AI生态

2026-04-21

12:15:37

来源: 江波龙

点击

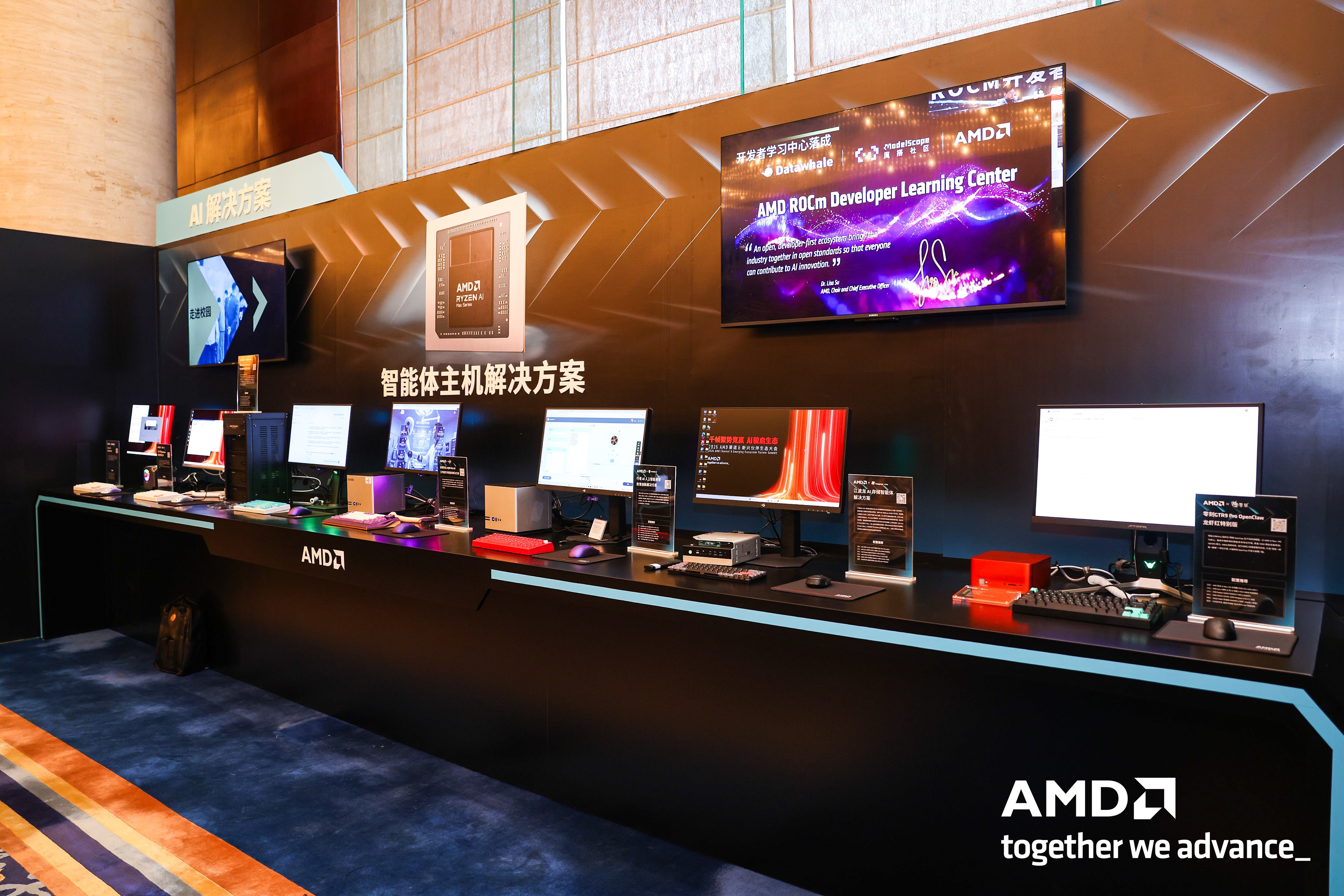

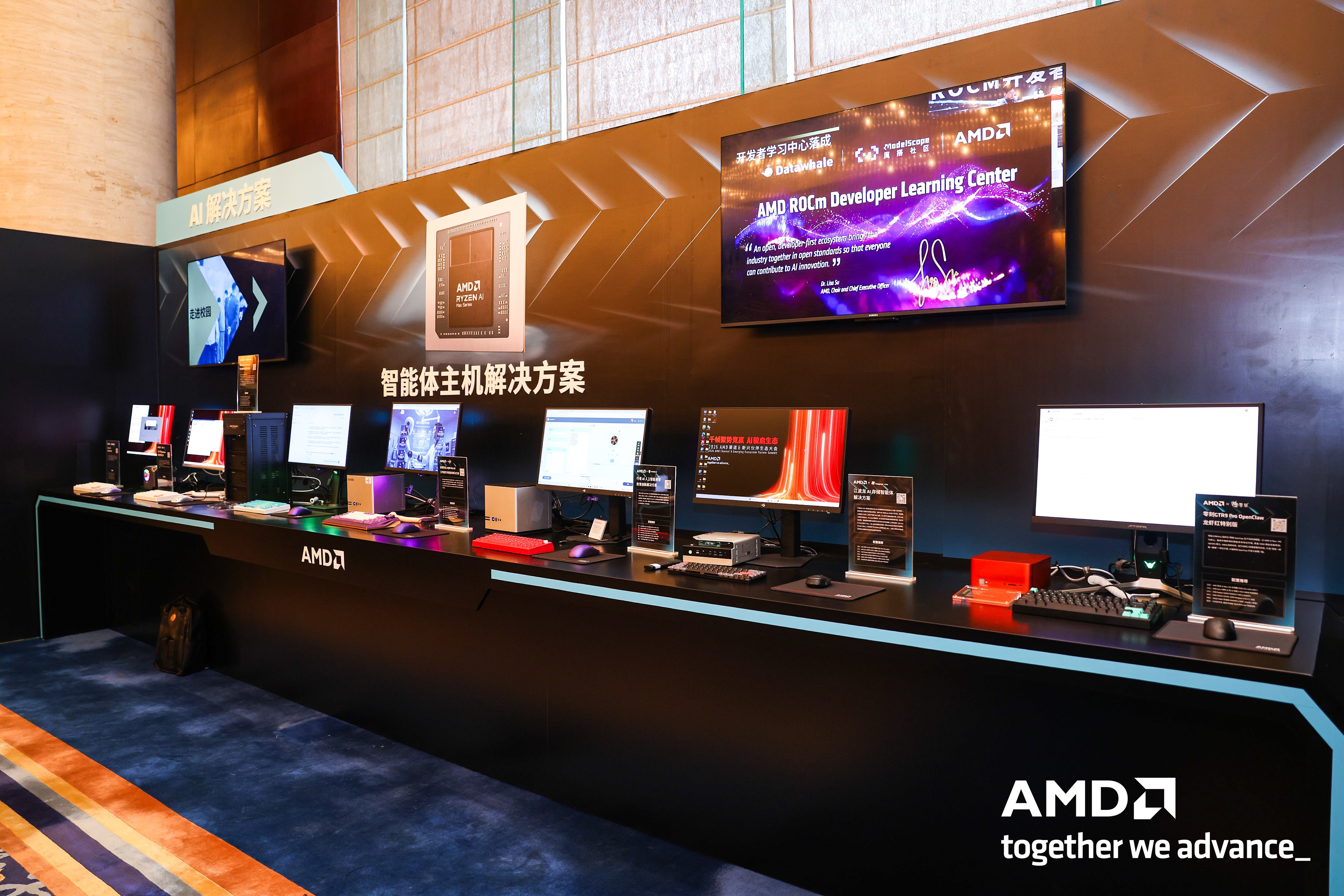

近日,以“千帧聚势竞赢 AI骏启生态”为主题的2026 AMD渠道&新兴伙伴生态大会顺利举办。作为AMD全球核心生态合作伙伴,江波龙携端侧AI集成存储方案亮相,公司董事长、总经理蔡华波受邀出席,与各方伙伴共探端侧AI生态的发展新路径。

协同AMD联合调优,端侧AI大模型本地部署新突破

存储Foundry模式,端侧AI存力需求量身定制

面向丰富的端侧AI场景,江波龙依托5nm制程工艺的SPU(Storage Processing Unit)存储处理单元、iSA(Intelligent Storage Agent)存储智能体与 HLC(High Level Cache)高级缓存技术,成功实现存储调度效率优化与DRAM使用量有效降低,进一步提升端侧AI设备用户体验;同时推出Gen5、Gen4多形态mSSD高速存储介质,不仅兼容M.2 2230规格,还可拓展出M.2 2280、2242等多种规格,衍生出AI/固态存储卡、PSSD等多样化形态,且在散热设计与硬件优化方面实现大幅升级,可全面适配各类端侧AI设备。基于这套集成存储方案,江波龙将协同生态伙伴,共同助力端侧AI设备高效运行各类系统应用。

协同AMD联合调优,端侧AI大模型本地部署新突破

大会上,江波龙展现了与AMD深度协同的技术成果,双方基于锐龙AI Max+ 395智能体主机开展了深度联合调优,取得了显著的优化进展。在128GB内存场景下,双方成功实现397B超大参数AI模型在本地的部署;在64GB内存场景中,不仅能实现122B大模型的本地部署运行,还能顺畅运行80B、122B等中大型模型并提升长上下文场景的表现,有效解决了端侧AI运行中内存使用过高的痛点,大幅提升了端侧AI计算的效率与经济性。

存储Foundry模式,端侧AI存力需求量身定制

江波龙董事长、总经理蔡华波在大会上表示当前AI已从云端训练全面走向端侧推理,云端与端侧协同分工、存储分层是行业大势所趋。江波龙立足集成存储技术优势,聚焦端侧 AI 存储创新,可与云端AI形成高效互补,针对端侧跑大模型存在的参数大、缓存膨胀快、I/O延迟高、内存占用多等痛点,推出端侧AI存储Foundry模式,提供从芯片设计、固件算法、硬件设计、工业设计,到材料工程、封装测试,再到制造交付的一站式解决方案。

面向丰富的端侧AI场景,江波龙依托5nm制程工艺的SPU(Storage Processing Unit)存储处理单元、iSA(Intelligent Storage Agent)存储智能体与 HLC(High Level Cache)高级缓存技术,成功实现存储调度效率优化与DRAM使用量有效降低,进一步提升端侧AI设备用户体验;同时推出Gen5、Gen4多形态mSSD高速存储介质,不仅兼容M.2 2230规格,还可拓展出M.2 2280、2242等多种规格,衍生出AI/固态存储卡、PSSD等多样化形态,且在散热设计与硬件优化方面实现大幅升级,可全面适配各类端侧AI设备。基于这套集成存储方案,江波龙将协同生态伙伴,共同助力端侧AI设备高效运行各类系统应用。

协同创新,共建开放端侧AI生态

大会期间,AMD正式宣布成立深圳生态创新中心,为端侧AI生态伙伴深化合作、加速技术成果落地搭建了重要平台。蔡华波表示,江波龙总部位于深圳,同时在大湾区布局中山存储产业园,深中两地联动高效便捷,研发与产业协同优势显著。未来期待与AMD继续深化合作、协同创新,快速打造更具竞争力的产品,共同构建开放包容的端侧AI生态,服务全球市场创新需求。

责任编辑:SemiInsights